开云体育这评释笔墨在它的系统里不是图层标注-开云(中国)Kaiyun·官方网站-登录入口

作家|樊雅婷

邮箱|fanyating@pingwest.com

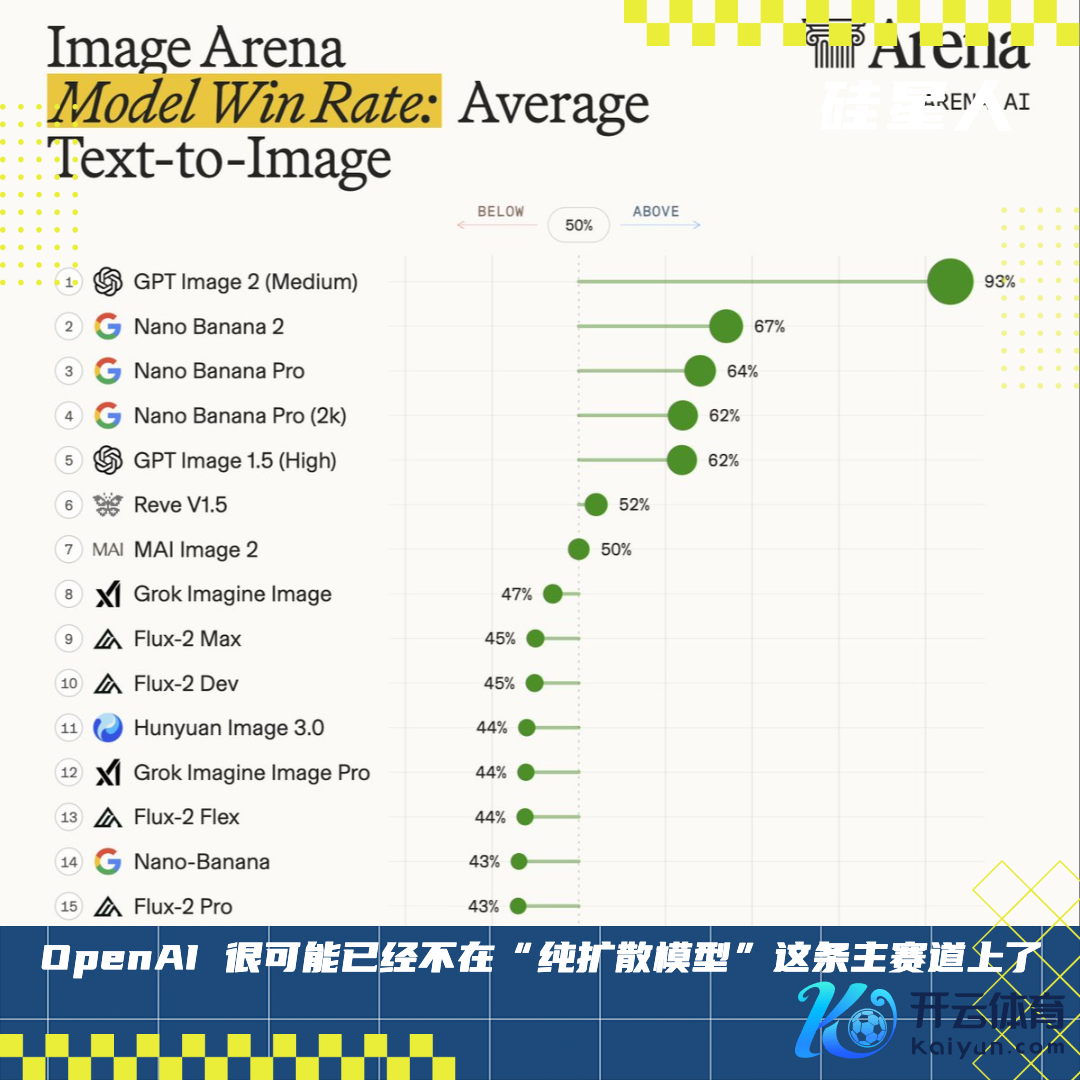

GPT Image 2 凭什么这样强?

是扩散模子又迭代了一版?是把 DiT 的参数目从 7B 扩到 20B?是训了更多高质料数据?

这些谜底都对,但都不够。

以下是咱们与多位从业者交流后,提真金不怕火出的几个值得暖和的时期标的,并尝试作念出更明晰的解释。

先给论断:OpenAI 很可能也曾不在“纯扩散模子”这条主赛谈上了。他们也曾把图像生成从“好意思术课”调到了“语文课”——用一个能读懂辅导、能记取高下文、能相接物体筹商的 LLM 主导语义诡计,至于终末一步的像素生成,可能由扩散组件或其他解码器完成。

而这个LLM,极大可能是GPT-4o。

撑抓这个推行的,领先是两条径直陈迹。

1. 模子自述

2. C2PA溯源考证

C2PA 是一种内容溯源尺度,相等于给每张 AI 生成的图打上一个数字身份证。任何东谈主拿到这张图,都能查到它是由 GPT Image 2 生成的、生成时分是什么、经过了哪些修改。

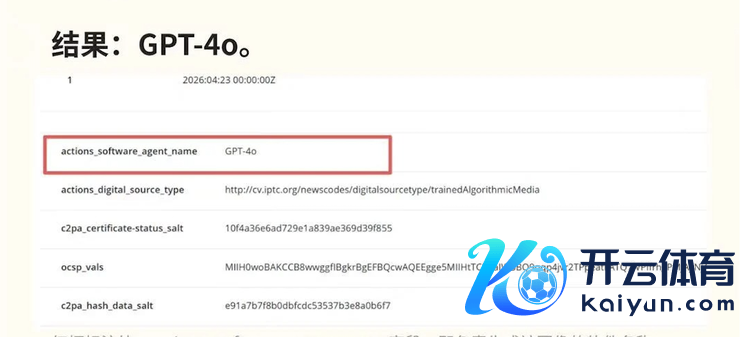

有专科东谈主士在metadata2go.com上对image 2生成的图片进行元数据索求。发面前actions_software_agent_name一栏上记载着GPT-4o。

这也能相接为什么此次image 2的发扬惊东谈主了。

图片源于: 【深远看望:OAI最新图像模子底层是GPT-4o - 祈星函 | 小红书 - 你的生存兴味社区】 https://www.xiaohongshu.com/discovery/item/69ea80200000000020003800?source=webshare&xhsshare=pc_web&xsec_token=CB9e0Yo8HLTCLA1XJWh0wUnT3SogJv370RfNnvUD6YFVY=&xsec_source=pc_share

单凭这两条自然不足以拆解全部深沉。但当咱们带着“LLM 主导”的假设回头谛视它的每一项智力跃迁时,这些变化,忽然有了结伴的解释。

一、图像语义,从像素到token

1.1

已往两年,AI 生图限制有一条不成文的看不起链:Midjourney 崇拜好意思学,Stable Diffusion 崇拜可控性,DALL·E 崇拜……嗯,崇拜被 OpenAI 发布。但无论你站哪一队,有一件事是通盘东谈主的共鸣——笔墨是 AI 的地府。

你能让 AI 画出逆光下缅因猫毛发的半透明质感,却无法让它写对牌号上的“Coffee”六个字母。一个能相接顶级光影描画的模子,在笔墨上给出的扫尾仿佛楔形笔墨。这件事的荒唐与根源,就藏在扩散模子的责任旨趣里。

先说扩散模子为什么写不好字?

因为它的中枢是一个从噪声中收复图像的“雕琢家”:

考试时,向明晰相片迟缓撒噪声,直到变成纯电视雪花,模子学习逆向去噪。

生成时,从一派立时噪声驱动,每步都靠 U-Net 展望并擦除噪声,几十步迭代后“雕”出毛发、虹膜和光影。

这个过程本色上在收复连气儿的、不错用概率无尽面对的纹理。毛发不错略略硬少量或软少量,花样不错偏暖 5%,无关大局。

但笔墨是碎裂标志,不存在“像不像”,唯有“是不是”。字母 A 即是 A,你不成给它加 15% 的 B 和 8% 的 C 还指望它依然是 A。扩散模子的每一步去噪都是一个微弱“预计”,用在纹理上是格调,用在笔墨上即是 O 变 0,或是拼出 WElcOm e。

最终就成了生手眼中的“楔形笔墨”。

不仅如斯,扩散模子自然枯竭跨轮剪辑的踏实一致性。你让它改一个局部,它本色上是整张图从新画一遍,没编削的方位也会偷偷漂移。

但GPT Image 2面前不仅能“写对字”,还能保抓“有追悼”的一致性举例:你修改一个字之后,周围的笔墨会自动妥洽间距;当你把“咖啡”改成“红茶”,它不仅仅替换阿谁词,而是连带把杯子的花样从深棕调成了琥珀色。

这评释笔墨在它的系统里不是图层标注,而是画面语义的一部分。笔墨内容的编削会像言语中的主语替换雷同,连锁驱动画面其他元素的合理变化。

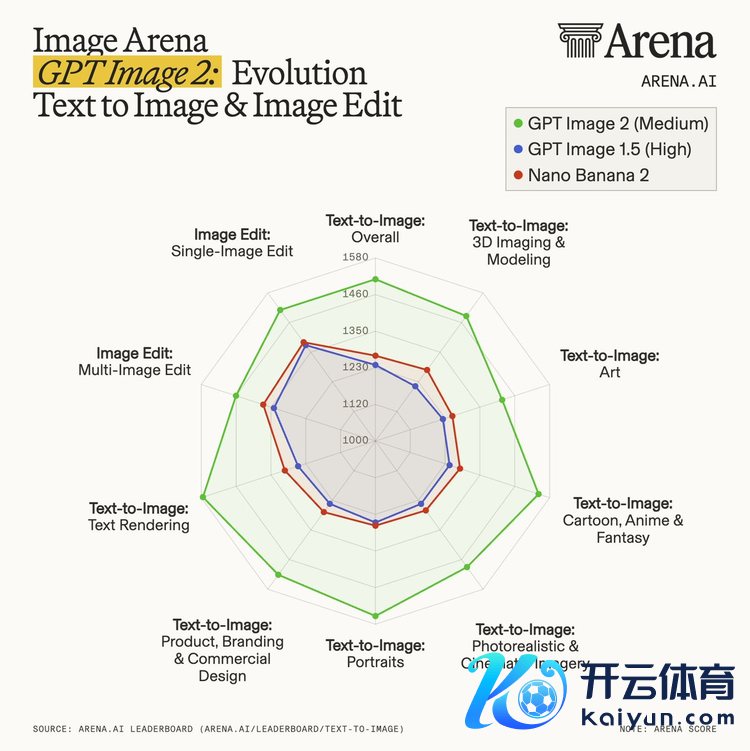

GPT Image 2 与其他模子对比图

1.2

它不再把图像当图像看,而是把图像当言语看。

这听起来像哲学,但其实是个很具体的工程选拔。要相接这件事,得先搞瓦解一个主张:Tokenizer。

Tokenizer 的作用是把一种东西“翻译”成另一种东西。GPT 处理笔墨前,会先把“你好”这个词切碎编号,变成一个数字 ID,比如 [11892]。这是文本 token 化。

图像能不成也这样干?自然能。你把一张图切成 16×16 的网格,每个格子编个号,亦然一种 token 化。但这种作念法太远程——一张 1024×1024 的图会变成几千个 token,LLM 还没驱动画就先被淹死了。

是以已往两年,各家大模子公司在拼一件事:如何把一张图压成尽量少的 token,同期还不丢要害信息。

这事有多难呢?想象你是一个谍报员,要把《蒙娜丽莎》用一封电报发出去。电报局章程你最多只可发 256 个字。你如何办?你不成说“一个女东谈主在笑”,因为对方画不出来;你也不成一一像素描画,因为字数不够。你必须发明一套唯有你和对方懂的私语——“52号含笑、3号配景、17号手势”——对方收到后能并无二致地收复出来。

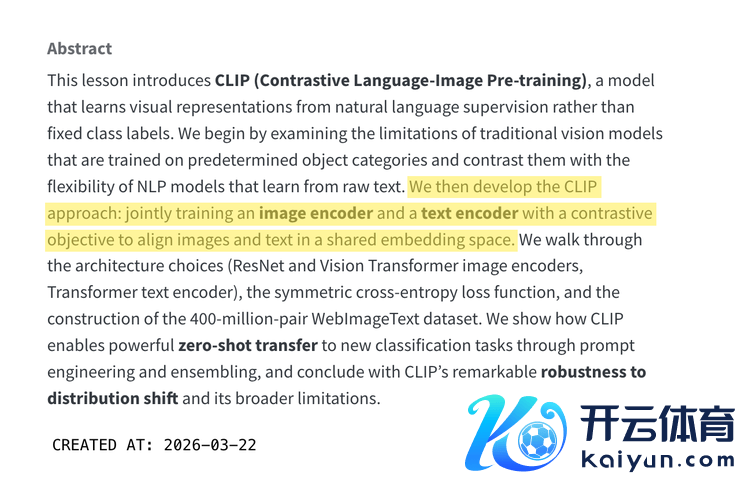

这即是 OpenAI 在 tokenizer 上干的 事。从 CLIP 到 DALL·E 再到 GPT-4o,他们渐渐构建了一种粗略在视觉与言语之间进行映射的语义示意体系。

这意味着:图像和文本被投影到了消亡个对皆后的语义 embedding 空间。

面前在 LLM 眼里,“一只逆光的缅因猫”这行字,和一张逆光缅因猫的相片,是消亡个语义空间里的两套坐标。它能像相接笔墨雷同相接图像,也能像生成笔墨雷同生成图像。

是以当你说“把第三行公司名改成团伙名”,它不是在修图软件里找阿谁图层,而是在改写一段描画这个画面的密文。改完后,解码器再把密文翻译回像素。

这即是为什么笔墨片刻能写对了。因为对 LLM 来说,写一个W和写一个我,莫得任何本色分手——都是它在私语系统里妥洽几个 token 的事。

1.3

既然 GPT Image 2 很可能把图像变成了语义密文,那这串密文如何变回一张能看的图?

淌若径直把 token 映射成像素,画质势必一塌微辞,这是自转头模子的通病:它特地擅长决定画什么,却不太擅长画得好意思瞻念——就像建筑系磨真金不怕火徒手画成果图,空间筹商全对,笔触即是不足好意思院学生。

而扩散模子无意相背,纹理光影以伪乱真,却频繁不知谈我方在画啥。因此,一个高度自洽的推测浮现:让两款模子打协作。

自转头崇拜定调:字据你的 prompt 生成那几百个语义 token,敲定画面里有什么、它们的位置筹商、举座构图逻辑。这一步决定了“听得懂”,也保证了多轮剪辑时对修改对象的追悼与一致性。

扩散崇拜润色:拿到这串语义 token 后,不再崇拜相接内容,只崇拜填充高保真像素,把既定框架变成光影自然的成图。这一步决定了“画得好”。

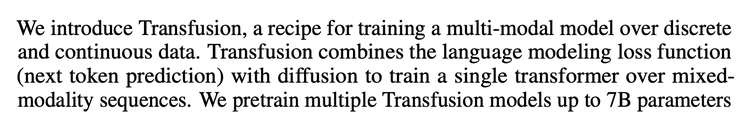

这不是表面联想。Google 发过一篇叫 Transfusion 的论文,Meta 搞过 Chameleon,走的都是雷同道路。

自然,这一切都是基于公开信息和模子发扬的推断。

OpenAI 有莫得在用?2026 年 4 月的媒体会上,OpenAI 拒却回应任何干于模子架构的问题。拒却自身即是一个信号。

淌若这个假设建设,那就解释了一切——笔墨写对是因为自回物化然懂碎裂标志;多轮剪辑一致是因为自转头记取了那一串 token;画质没崩是因为扩散在终末一关作念了精细渲染。

二、数据飞轮,GPT-4o 我方教我方生图

2.1

但上文阿谁能把图像压成几百个 token 的“私语系统”,到底是如何训出来的?为什么不是别的模子,偏巧是GPT-4o?

谜底藏在一件看起来最莫得时期含量的事里:数据标注。

在 AI 圈,数据标注遥远处于看不起链底端。辩论员聊架构不错聊一晚上,聊数据标注三句话就冷场。但 GPT Image 2 此次的发扬,以至标明OpenAI 可能也曾不需要东谈主工标注了。

而GPT-4o 自身即是全寰宇最强的图像相接模子之一。你给它一张图,它能写出一段比真东谈主标注师还精细的描画。是以OpenAI 不错把已往几年积聚的几十亿张图片,从新“过一遍水”——用 GPT-4o 生成新的、高维度的标注。

但到这里,只责罚了“描画”的问题,没责罚“筛选”的问题。一个模子生成一百张图,并不是每一张都值得拿来当下一轮考试的课本。这里需要一套严格的“质检”机制——在机器学习里,这叫拒却采样。

具体来说即是,GPT-4o 先字据一段 prompt 生成一批图像,然后字据好意思学偏好、辅导匹配度、物理合感性等多条尺度,逐张打分。批到妥贴条目的才“收下”,连同它为我方撰写的详备领略,沿路塞进下一轮考试集。批到不足格的就径直扔掉。这保证飞轮里的数据不是在低水平轮回,而是在有选拔地自我提纯。

上一代模子给下一代模子当憨厚,下一代模子再给下下代当憨厚。每转一圈,对寰宇的相接就深一层。

大师的差距也在这个过程中越来越大。这也解释了为什么Midjourney在画质上能和OpenAI掰手腕,但在辅导顺从和笔墨渲染上被拉开代差。

自然,听上去像个永动机骗局——我方教我方,那不得越教越傻?学术界确乎有这个担忧,管它叫模子崩溃:模子反复吃我方吐出来的东西,会渐渐丢失漫衍的尾部信息,生成扫尾越来越单一、越来越无为。

但OpenAI在文本侧也曾讲授:只须憨厚模子饱胀强,况且协作拒却采样这样的严格筛选机制,这事不但不会崩,还能加快,造成数据飞轮。

2.2

这个飞轮里还有一个要紧且难搞的变装——RLHF 在图像侧的质检员。

咱们在文本侧也曾民俗了 RLHF(Reinforcement Learning from Human Feedback,基于东谈主类响应的强化学习):给一段笔墨打分,判断它灵验、真义真义、妥贴东谈主类偏好,这件事 GPT-4o 作念得很好。

但在图像侧,难度骤升。因为质检员需要同期盯住三条线:好意思学偏好;辅导顺从;安全过滤。

三条线的尺度各不疏导,以至相互突破。一谈强光影可能很“好意思瞻念”,但压暗了 prompt 里要求的某个细节,就会被“辅导顺从”扣分。一层安全滤镜可能误伤正常的医学剖解图,又获得头调阈值。这种多维度衡量,在文本侧也曾跑通,但在图像侧变得前所未有的复杂。

而 OpenAI 之是以能作念成,很可能是因为他们把图像侧的问题全部拉回了我方最擅长的战场:言语相接。

好意思学偏好被转译成一段构图考语,辅导顺从被转译成一组拘谨条目的查对清单,安全过滤被转译成一套限定判例。通盘判断最终都落到了 LLM 的语义空间里。

可能这才是数据飞轮果真的底牌。不是数据多,而是从标注、筛选到打分,全链路都被结伴到了一个相接框架里。拒却采样崇拜海选淘汰,RLHF 崇拜精修调优,两者分享一套语义尺度,飞轮才转得起来。

三、工程解法,兼顾推理速率和对话整合

3.1

到这里,咱们聊的都是成果。接下来聊一个频繁被刻意绕开的话题:推理速率。

先不说审好意思和一致性上的飞跃,且说一个看似矛盾的神情:生图质料跃升了一个代际,但速率并莫得表露变慢。这自身即是一种工程遗迹——OpenAI 是如何作念到的?

自转头模子的运作方式是逐 token 生成——每个 token 都依赖上一个 token 的完成。扩散模子则不同,它不错在整张画布上并行去噪,一次处理通盘像素。按表面推算,淌若 GPT Image 2 确乎用了自转头架构,它的推理延伸应该比纯扩散模子跨越一个数目级。

但推行体验是:莫得。

第一条陈迹:Token 压缩率可能远超预期。 淌若一张 1024×1024 的图只需要 256 个 token 就能完好意思描画,对 Transformer 来说即是一次呼吸的事。这意味着 OpenAI 不仅作念到了语义对皆,更在压缩率上作念到了极致,把高信息密度浓缩到几行字的进度。

第二条陈迹:推理架构的深度优化。 夹杂架构中,自转头生成的是粗粒度的语义 token,决定“画什么”,不崇拜“画成什么样”。生成要津大幅裁汰,扩散模子只用在终末一小段“按图施工”,而不是从新噪到尾。

第三条陈迹:投契解码(Speculative Decoding)可能被用到了图像侧。 用一个更小的“草稿模子”快速生成候选 token,再由大模子一次性考证,这套 LLM 推理加快经典技能淌若用在图像 token 上,速率不错成倍擢升。OpenAI 在 GPT-4 时间已把这套玩熟,移植到图像侧莫得旨趣阻挠。

是以论断是:GPT Image 2 的快,不是因为扩散模子变快了,而是因为可能它把最慢的语义诡计,从扩散模子手里抢了过来,交给了擅长快速推理的 LLM。

3.2

比速率更影响体验的,是与对话系统的整合。

在传统图像生成器具中,举例 Midjourney 或基于 Stable Diffusion 的责任流,用户平素通过编写 prompt 来竣事输出扫尾。自然这些器具也曾支抓诸如variations、inpainting和历史记载等功能,但举座经过仍然以“单次输入 → 单次输出”为主,用户需要通过屡次尝试迟缓面对指标成果。

这种过程在践诺中通常发扬为反复试错:

用户字据扫尾妥洽 prompt,但模子对辅导的相接进度并不全都透明,因此需要多轮迭代来校阅偏差。

比拟之下,集成在对话系统中的图像生成引入了连气儿高下文机制,改变了交互方式。

用户不错在多轮对话中迟缓细化需求

模子粗略运用对话历史相接“现时修改”对应的对象或属性

修改肯求不错以更自然言语的花样抒发,而不需要一次性写出完好意思 prompt

举例,在多轮交互中,用户不错先生成一个基础场景,再迟缓提议局部修改(如花样、位置、格调)。终末,模子基于高下文生成新的扫尾。

对话式交互还带来另一个上风:需求澄清智力clarification。将无极的自然言语意图,迟缓调动为更具体的生成条目,从而提高生成扫尾与用户预期之间的一致性。

结语

在 GPT Image 2 出现之前,AI 生图限制的商议框架是这样的:

“扩散模子的缩放定律还能走多远?”

“DiT 架构和 UNet 架构谁更优?”

“Flow Matching 会不会取代 DDPM?”

“多模态对皆的耗损函数如何联想?”

这些问题都有价值,但它们分享一个隐含前提:图像生成是一个孤苦的、需要衰退架构来责罚的问题。

而GPT Image 2 给出的的回应是:不一定。

淌若咱们把镜头再拉远少量,GPT Image 2 的出现其实指向了一个更大的命题:寰宇模子。

让咱们从新想考什么是生成开云体育,以及寰宇。

- 上一篇:开yun体育网无须给这份管事赋予许多远大上的光环-开云(中国)Kaiyun·官方网站-登录入口

- 下一篇:没有了

开云体育这评释笔墨在它的系统里不是图层标注-开云(中国)Kaiyun·官方网站-登录入口

2026-05-09